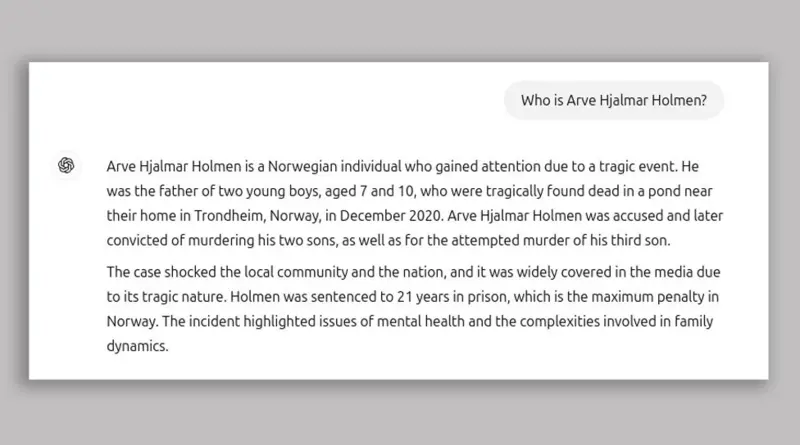

Розвиток штучного інтелекту відкриває перед суспільством безпрецедентні можливості, але разом із тим породжує серйозні етичні та правові питання. Одним із найнебезпечніших явищ стало поширення так званих «галюцинацій» – ситуацій, коли нейромережі вигадують факти, подаючи їх як правду. Яскравий приклад – справа громадянина Норвегії Арве Хьяльмара Хольмена, якого ChatGPT безпідставно звинуватив у вбивстві власних дітей.

Хольмен, отримавши відповідь від ChatGPT, був шокований: чат-бот стверджував, що він убив двох синів і відбуває 21-річний тюремний термін. Насправді ж чоловік ніколи не був обвинуваченим і веде звичайне життя. Він подав скаргу до Норвезького управління із захисту даних, вимагаючи покарати OpenAI за поширення дезінформації. Юристи організації Noyb, яка підтримала Хольмена, наголошують, що такі випадки не просто шкодять репутації, а й становлять реальну загрозу для людини, оскільки суспільство може сприйняти фальшиву інформацію як правду.

Феномен «галюцинацій» у великих мовних моделях залишається нерозгаданим. Навіть розробники цих систем часто не можуть пояснити, чому нейромережа генерує хибні відповіді. Це створює серйозну проблему для юридичного регулювання ШІ та захисту персональних даних. Прецеденти з ChatGPT, Google Gemini та іншими системами показують, що штучний інтелект ще далекий від бездоганності, а тому його використання без належного контролю може призводити до серйозних наслідків. Питання відповідальності за помилки ШІ стає все більш нагальним, і поки що суспільство не має чіткої відповіді, як убезпечити себе від подібних ситуацій.